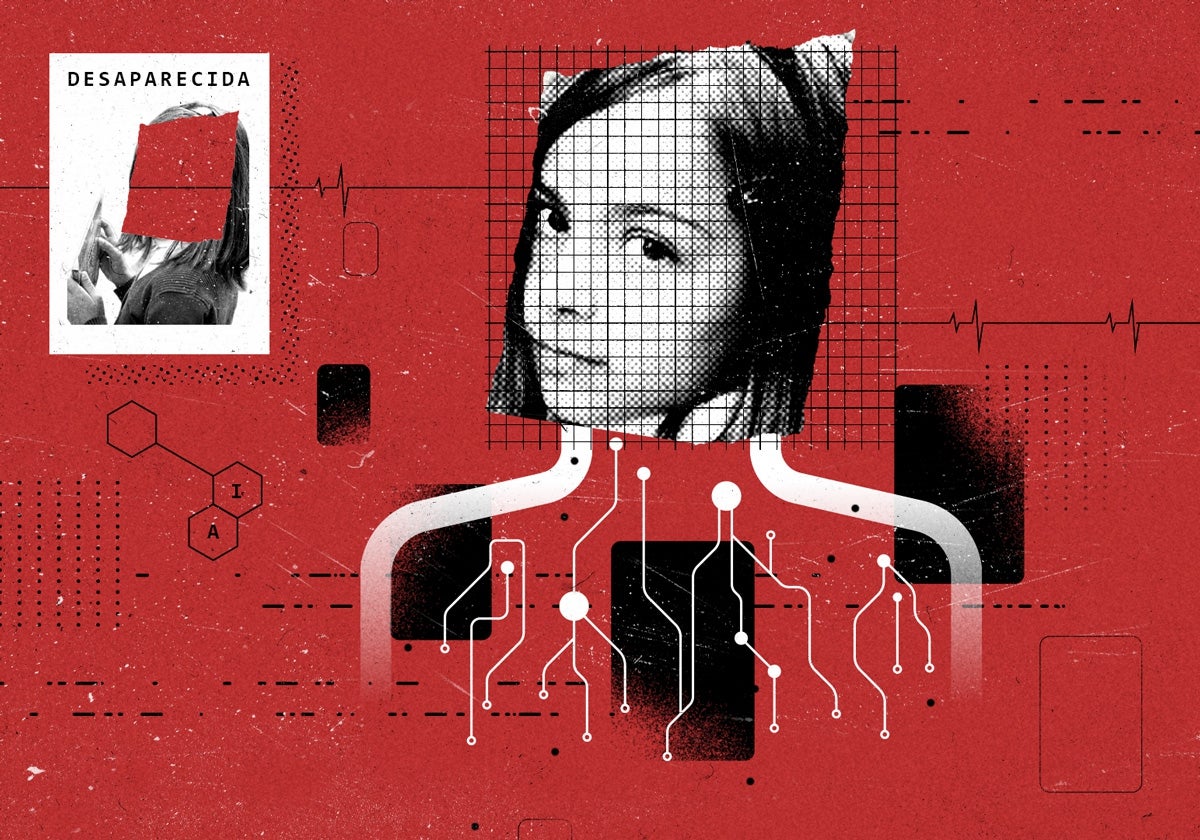

La inteligencia artificial 'revive' a víctimas infantiles de crímenes: «Usar la cara y la boca de un niño que nos han arrebatado... no hay palabras»

La tendencia viral avanza en plataformas como Tik Tok ante el asombro de la mayoría de las familias afectadas, a las que nadie les pide permiso

La tecnología también recrea el relato que suele ser extremadamente detallado de los asesinos

Las nuevas soluciones para acabar con el crimen y poner cara al sospechoso

Esta funcionalidad es sólo para registrados

Iniciar sesiónEl término 'deepfake' se ha convertido en el sospechoso habitual, especialmente en las noticias del último año. Esta capacidad de la Inteligencia artificial (IA) para crear o manipular vídeos o imágenes con el fin de que tengan la apariencia de algo auténtico ha encontrado ... un nuevo nicho del que sacar partido y alentar a otros a hacer sus propias creaciones.

Un efecto contagio que para muchos tiene su recompensa en forma de 'likes' y visualizaciones, donde las líneas rojas se difuminan. Ya que ahora lo nuevo y perturbador que viene de la mano de la IA es hacer vídeos recreando las imágenes y clonando las voces de víctimas infantiles de asesinatos para que cuenten en primera persona y mirando a cámara cómo fue su crimen. Y la práctica no para ahí, también se están produciendo contenidos donde los presuntos asesinos cuentan cómo llevaron a cabo sus actos.

Esta tendencia, que se hace eco desde distintas cuentas de Tik Tok, ya se ha convertido en global abarcando asesinatos, desapariciones, muertes accidentales que involucran a infantes de Estados Unidos, Reino Unido como Madeleine McCann, y España no es una excepción. Las imágenes de Yeremy Vargas, Marta del Castillo, el niño pintor de Málaga o el del pequeño Julen, entre otros, se han recreado con IA.

Un contenido producido sin el consentimiento previo de sus familias ni sin consideración del efecto que puede tener sobre ellos. Algunos incluso usan la imagen de la víctima para acusar, sin pruebas, a alguien. Una especie de 'True crime' digital con el lema 'esta es mi historia' que se ha multiplicado en los últimos meses. Muchos internautas ante esta nueva moda comparten por unanimidad una misma pregunta: «¿Qué narices le pasa hoy a la gente para llegar a esto?»

«Usar la cara y la boca en movimiento de un niño que ya no está aquí, que nos han arrebatado brutalmente, no hay palabras»

Denise Fergus, madre de uno de los niños asesinados

Con estos tipos de vídeo se incide en una revictimización, agravando gratuitamente el dolor de los que están de luto. La primera madre en alzar su voz contra este tipo de creaciones fue la de James Vulger, un caso británico que causó conmoción en 1993. Un niño de dos años que fue secuestrado en un centro comercial mientras su madre pagaba la compra. Los autores de su tortura y asesinato fueron Robert Thompson y Jon Venables, ambos de diez años, quienes lo abandonaron en una vía del tren. Las imágenes de las cámaras de vigilancia y los análisis forenses confirmaron la identidad de sus atacantes que se convirtieron en los asesinos más jóvenes de Gran Bretaña.

La madre de James Bulger, Denise Fergus, tras ver en uno de los vídeos generados por IA a su hijo hablando sobre su asesinato lo consideró algo perverso. «Es más que enfermizo». Entre otras cosas porque muchos de los vídeos son extremadamente detallados a la hora de contar las circunstancias de una muerte, y otros introducen elementos gráficos como hacer aparecer al niño ensangrentado o llenos de cicatrices y acompañado de una música deliberadamente dramática.

Es más, en el vídeo con IA de Bulger incide en decir: «Si mi mamá hubiera girado a la derecha, hoy podría haber estado vivo. Desafortunadamente, giró a la izquierda». Esto se debe a que Fergus en diversas entrevistas llegó a comentar que uno de sus mayores lamentos es no haber girado a la derecha cuando buscaba a su hijo, porque entonces hubiese visto a los dos niños llevándose a James. «Usar la cara y la boca en movimiento de un niño que ya no está aquí, que nos han arrebatado brutalmente, no hay palabras», comentó al 'Daily Mirror'. Y pese a todo, la BBC informó de que este vídeo llegó a recibir más de cuatro millones de visitas.

«Una cosa es contar la historia -aclaró también Fergus a los medios-; no tengo ningún problema con eso. Todo el mundo conoce la historia de James». Pero esto es algo distinto. Su marido llegó a pedirle a la productora que hizo el vídeo que lo eliminasen. Sin embargo la respuesta fue: «No pretendemos ofender a nadie. Solo hacemos estos vídeos para asegurarnos de que este tipo de incidentes nunca vuelvan a sucederle a nadie. Continúe apoyando y compartiendo mi página para crear conciencia».

Los muertos no tienen derechos

Borja Adsuara, abogado experto en derecho digital, explica a ABC que en España los muertos en principio no tienen derechos, pero sí los tiene la familia con el fin de que no se ensucie el buen nombre del fallecido. El derecho al honor, a la intimidad y la propia imagen son unos derechos fundamentales que están en el artículo 18 de la Constitución y se pueden proteger por vía penal, civil o por vía administrativa. «Los familiares podrían presentar por la vía civil una reclamación, una indemnización por daños y perjuicios, además de obligar al autor del vídeo a cesar en el uso de la imagen de esa persona», señala.

Pero también matiza que si bien se está haciendo un uso muy doloroso para la familia de la imagen de una persona, no se puede generalizar y habría que ir caso por caso, porque un juez puede estimar que la libertad de información está por encima. «Todo depende de si la familia es consciente o no de ese uso, y de si se trata de un vídeo para crear morbo en redes sociales, donde las cosas que se dicen pueden hacer mucho daño y encima no ser ciertas, ya que se pueden inventar una historia que realmente no coincida con los hechos probados en el juicio. Entonces seguramente prevalezca el derecho de las familias», apunta Adsuara.

Luego está el tema de los vídeos de los asesinos. En ese sentido, Adsuara menciona que se ha hecho incluso recientemente un vídeo reciente del caso de Tailandia. Y nos detalla que mientras no esté condenado, incluso aunque haya confesado no se pueden dar por sentado unos hechos, porque la presunción de inocencia no desaparece hasta que haya una condena en firme.

«Además imaginen que alguien simplemente está detenido o bajo sospecha y se encuentra uno de estos vídeos diciendo: «Sí, yo lo hice» como si fuera una confesión suya. Se está predisponiendo al público, con una imagen muy realista, a creer que es el verdadero criminal», afirma Adsuara.

Un guion y una escenografía estudiados

Otros casos que nos encontramos es por ejemplo el de un niño malnutrido y maltratado que dice: «Yo era el objetivo de la práctica de tiro con pistola de aire comprimido de mi madre ». O el vídeo de Gabriel Fernández, un niño de 8 años, de California, que fue torturado hasta la muerte por su madre y su novio en 2013, y que contiene frases dirigidas a la cámara del tipo: «¿Es normal sangrar cuando mi madre me pega con el cinturón?», ha sido visto más de 25 millones de veces en Tik Tok.

Algunos se escudan en decir que los crearon para honrar la memoria de los infantes muertos. Paul Bleakley, profesor asistente de justicia penal en la Universidad de New Haven, comentó a la prensa que «parecen diseñados para desencadenar fuertes reacciones emocionales con el que conseguir el tan deseado 'me gusta'. Creo que ese podría ser el punto«.

Se usan hasta víctimas de 20 meses para conseguirlo, es el ejemplo de Royalty Marie, apuñalada y quemada en 2018. Este vídeo destaca porque su autor cambió la raza de la niña que era afroamericana a caucásica, además de introducir otros errores. Y también hay casos más antiguos como el de Carl Newton Mahan, un niño de 6 años de Kentucky que mató a tiros a otro niño de 8 años en 1929.

Tik Tok está procediendo a eliminar muchos de ellos, pero por ejemplo el de Madeleine McCann, la niña británica de 3 años que en 2007 desapareció durante unas vacaciones con su familia en el Algarve portugués, según confirmó 'The Washington Post', antes de que fuese eliminado ya lo habían visto decenas de miles de personas. Su creador detallaba que era simplemente un intento de «narrar historias inmersivas». El interés que generan ha provocado que muchos contenidos hayan sido traducidos a otros idiomas: alemán, portugués, polaco…Cada vez se hace más fácil animar figuras humanas y crear un guión con la IA.

El periódico estadounidense menciona que incluso se ha usado en uno de los vídeos a Ana Frank anunciando ropa de bebé antes de hablar de los horrores del Holocausto. «¿Sigues buscando ropa de bebé bonita y de diseño propio? Entonces entra en el enlace de mi biografía y déjate sorprender». Y tampoco escapan a esta tendencia las víctimas adultas como el asesinato del afroamericano George Floyd por un oficial de policía en Minneapolis.

En cuanto a la responsabilidad, el abogado Adsuara detalla que recae sobre el autor de las imágenes. En el caso de Tik Tok, explica que las plataformas no tienen que retirar vídeos hasta que no tengan conocimiento efectivo de que se trata de un contenido ilegal. Y añade: «no tienen la obligación de monitorizar todos los millones de vídeos que se suben cada segundo. Sin embargo hay que precisar que si le dices a una red social que retire un contenido que es claramente ilegal y no lo hace, ahí empieza a tener responsabilidad por no actuar con diligencia», afirma.

Sedar Soares, un caso diferente

Por todas las razones esbozadas hasta el momento no se hace puesto en este artículo ninguno de esos vídeos. Sin embargo, hay un caso excepcional en el que se usó la IA para dar voz a Sedar Soares, asesinado en 2003. Para Adsuara, aquí, el detalle importante es que en esta ocasión sí se contó con el consentimiento de los padres. Y lo creó la policía holandesa, en 2022, para que se difundiera públicamente. Tanto los padres de la víctima como la policía consideraron que sería útil para atraer la atención del público sobre un caso antiguo sin resolver, al tiempo que serviría de llamamiento para encontrar a alguien que pudiera proporcionar información.

Creado con IA por la policía holandesa

«Nunca podremos recuperarle, pero ojalá que esto aporte algunas respuestas»

Vídeo de Sedar Soares

Soares tenía 13 años y fue asesinado por un disparo mientras se encontraba jugando en la nieve con sus amigos, cerca de una estación de metro en Róterdam.

En el clip se muestra que el sueño de Soares era convertirse en futbolista mientras camina por un campo de fútbol con un balón bajo el brazo acompañado de sus compañeros de clase, profesores y familiares. Janet Soares, su hermana, explica cómo murió y pide colaboración. Cuando Sedar deja la pelota dice: «¿Sabes algo? Habla ahora». El vídeo termina con el mensaje: «Nunca podremos recuperarle, pero ojalá que esto aporte algunas respuestas».

Antes de esta iniciativa, durante la investigación llegó a haber un sospechoso, Gerald H, con antecedentes por drogas y una condena por un tiroteo. Y diversos testimonios hicieron concluir que fue él quien asesinó al joven disparándole una bala en la cabeza que hizo que falleciera al día siguiente. Aunque el arma nunca apareció, pero eso no evitó que lo condenaran a 15 años de prisión en 2005. Sin embargo, un año después apeló, y varios testigos se retractaron, por lo que quedó en libertad.

18 meses después la policía consiguió nuevas pistas que indicaban que el adolescente pudo haber sido una víctima colateral de un choque entre bandas por un tema de drogas. Sin embargo, el caso sigue sin resolver.

Daan Annegarn detective del Equipo Nacional de Investigación y Comunicación de la policía holandesa declaró que «Sedar estaba en el lugar equivocado en el momento inoportuno. Casi 20 años después, buscamos a un testigo diferente. No al que pasaba por allí por casualidad, sino a los que pudieran saber qué ocurrió antes, durante y después de lo que parece un robo entre bandas».

Y en relación al vídeo puntualizaba que «era preciso cruzar una barrera preguntando a los familiares si podíamos devolver a su ser querido a la vida a través de un 'deepfake', y eso no es cualquier cosa, pero estamos convencidos de que puede ayudar a que se lleve a cabo una detención«.

MÁS INFORMACIÓN

- El polémico negocio de las prisiones

- La tecnología nunca descansa para combatir un crimen cada vez más sofisticado

- Máquinas expendedoras contra 'una epidemia' que está causando 'barrios zombie' y problemas geopolíticos

- Hidrodominación: 'las guerras del agua' y la inteligencia artificial revelan un peligro real y latente

El dato llamativo en todo esto - más allá de la temática de la IA como herramienta- y sobre el que cabe reflexionar es que mientras este contenido de Sedar Soares ha conseguido unas cien mil visualizaciones, los vídeos de Tik Tok, hechos sin consentimiento y sin conocimiento de los familiares de las víctimas siguen acumulando millones de visitas.

Esta funcionalidad es sólo para suscriptores

Suscribete

Esta funcionalidad es sólo para registrados

Iniciar sesiónEsta funcionalidad es sólo para suscriptores

Suscribete