Fábricas de pornografía de bolsillo: la IA amenaza con inundar internet con desnudos de menores

Un organismo de vigilancia británico ha encontrado en la 'dark web' más de 3.000 imágenes de abuso a niños que infringen la ley de Reino Unido

A la velocidad que avanza esta tecnología, temen que estos contenidos distraigan a las agencias policiales de detectar abusos reales y ayudar a las víctimas

Porno infantil, violaciones y tortura: el contenido que mina la salud mental de los moderadores de TikTok

Madrid

Esta funcionalidad es sólo para registrados

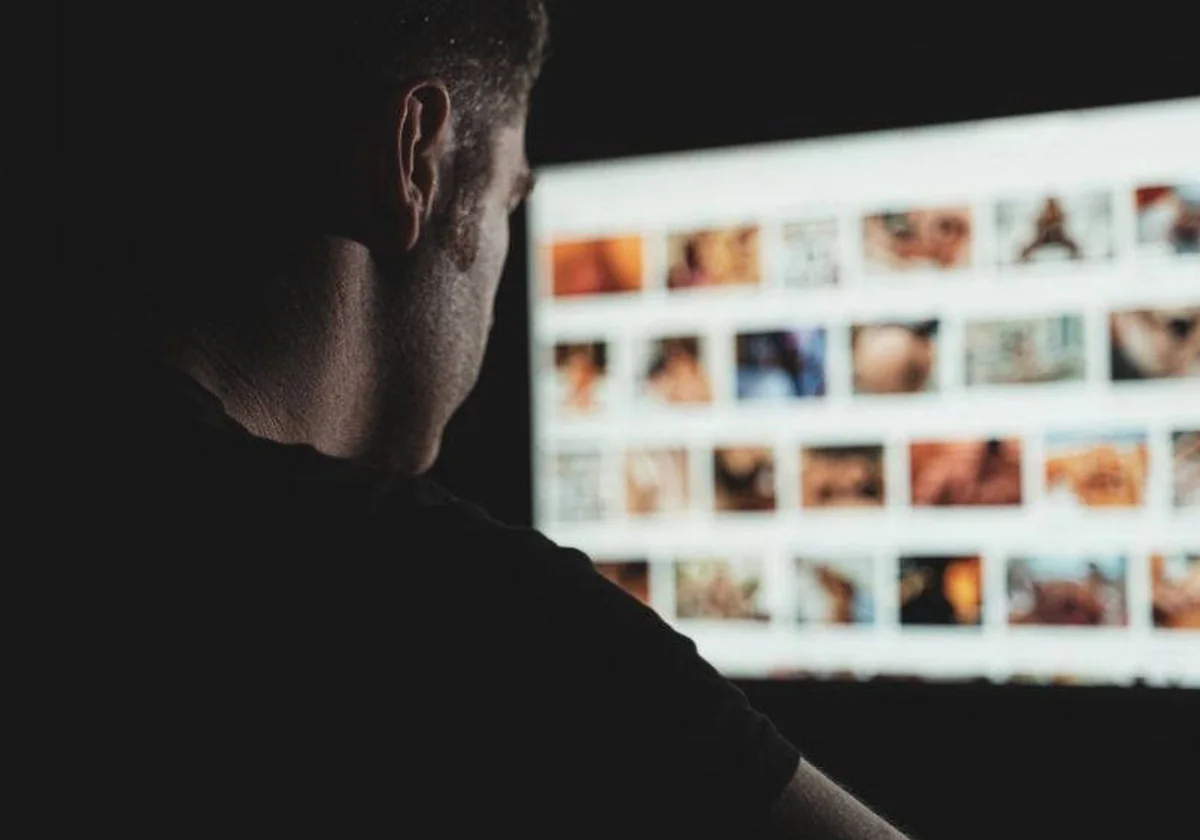

Iniciar sesiónLas peores pesadillas sobre las capacidades nocivas de la inteligencia artificial (IA) se están haciendo realidad. Mentir dando información errónea, hacer ver que un líder político se rinde en medio de un conflicto armado o que el Papa lleve un abrigo 'streetwear'. Al principio ... parecían nimiedades, hasta que su uso ha comenzado a vulnerar la intimidad de los menores, generando falsos desnudos de ellos en menos de cinco segundos y con la precisión de un cirujano.

Hace apenas un mes, en Almendralejo (Badajoz) una decena de chavales difundieron imágenes trucadas de más de treinta compañeras de instituto; y este martes la Policía detuvo a otro menor por crear y distribuir pornografía infantil en Barcelona generada con IA. Ahora, la Internet Watch Foundation (IWF), un organismo de vigilancia de la seguridad en la red, ha revelado en un informe que la pornografía infantil creada con esta herramienta no cesará e «inundará internet en un futuro cercano».

La organización con sede en Reino Unido ha explicado que las imágenes existentes de víctimas de abusos en la vida real se están incorporando a modelos de inteligencia artificial, para luego producir masivamente nuevas representaciones a partir de ellas. Son «fábricas de pornografía de bolsillo«, al alcance de cualquiera que tenga conexión con la red y un teléfono móvil.

En menos de un mes, han encontrado más de 3.000 imágenes de lo que etiquetan como 'AI CSAM' (siglas en inglés de material de abuso sexual de menores generado por inteligencia artificial), en 11.000 contenidos confiscados de la 'dark web'. Ya en verano, la IWF detectó un aumento de pruebas de abusos provocados en IA, pero en los dos últimos meses la situación se ha acelerado exponencialmente.

«A principios de este año, advertimos que las imágenes trucadas pronto podrían volverse indistinguibles de fotografías reales de niños que sufren abuso sexual, y que podríamos comenzar a ver estas imágenes proliferando en cantidades mucho mayores. Por desgracia, ya hemos superado ese punto», explica para ABC Susie Hargreaves, directora ejecutiva de la IWF. Con una sola foto, las herramientas de generación de imagen son capaces de crear más de una decena de variables realistas en segundos.

«Es escalofriante ver cómo los delincuentes entrenan deliberadamente su IA con imágenes de víctimas reales que ya han sufrido abusos. Los niños que han sido violados en el pasado ahora están siendo incorporados a nuevos escenarios porque alguien, en algún lugar, quiere verlo», añade Hargreaves. La IWF dijo que la gran mayoría del material ilegal que había encontrado infringía la ley de Protección de Niños, y más de una de cada cinco de esas imágenes se clasificaba en la categoría A, el tipo de contenido más grave, que puede representar desde violaciones y actos sexuales hasta casos de tortura. Su mayor temor es que estos contenidos distraigan a las agencias policiales de detectar abusos reales y ayudar a las víctimas.

«Como si no fuera suficiente que las víctimas sepan que su abuso puede estar siendo compartido en algún rincón oscuro de internet, ahora corren el riesgo de enfrentarse a nuevas imágenes de ellos mismos siendo abusados de maneras nuevas y horrendas que nunca antes habían imaginado», lamenta Hargreaves. Además de víctimas de abuso, se han encontrado imágenes de menores famosos, como actores o creadores de contenido de internet.

Las empresas de IA guardan silencio

En el informe señalan a los generadores de imágenes de IA más famosos, como Midjourney, Runway, Stable Diffusion y Dall-E de OpenAI, como las responsables de permitir la creación de estos delitos. Stability AI, la empresa británica detrás de Stable Diffusion, ha respondido al informe, explicando que la compañía «prohíbe cualquier uso indebido con fines ilegales o inmorales en nuestras plataformas, y nuestras políticas son claras en que esto incluye CSAM». El resto de empresas no se han comunicado al respecto, pese a la insistencia del organismo de vigilancia de internet.

Los generadores prohíben términos y palabras para evitar que se creen contenidos ilegales, pero IWF explica que, dentro de las comunidades de IA CSAM, se comparten «consejos y rutas de acceso» para saltarse los controles. «Además son capaces de crear versiones de estos programas desconectadas de los servidores oficiales, permitiendo generar escenarios, características de niños y situaciones con total libertad y sin ser detectados», comentan en el informe.

Medidas a nivel internacional contra la pornografía infantil

Por su parte, el gobierno británico ha dicho que el contenido de abuso sexual infantil generado por IA estará cubierto por el proyecto de ley de seguridad en línea, que se convertirá en ley de manera inminente, y que las empresas de redes sociales deberán evitar que aparezca en sus plataformas. El grupo de Reino Unido ha pedido la colaboración internacional para luchar contra el flagelo del CSAM, proponiendo un enfoque de varios niveles, que incluye cambios en las leyes pertinentes, actualización de la capacitación policial y establecimiento de supervisión regulatoria para los modelos de IA.

La Unión Europa ya está buscando medidas para pararle los pies a los pedófilos. Los Veintisiete buscan sacar adelante una ambiciosa ley que, entre otras cosas, permitiría escanear los mensajes enviados por sospechosos con el objetivo de descubrir contenido pedófilo o de acoso hacia los más jóvenes.

Límite de sesiones alcanzadas

- El acceso al contenido Premium está abierto por cortesía del establecimiento donde te encuentras, pero ahora mismo hay demasiados usuarios conectados a la vez. Por favor, inténtalo pasados unos minutos.

Has superado el límite de sesiones

- Sólo puedes tener tres sesiones iniciadas a la vez. Hemos cerrado la sesión más antigua para que sigas navegando sin límites en el resto.

Esta funcionalidad es sólo para suscriptores

Suscribete

Esta funcionalidad es sólo para registrados

Iniciar sesiónEsta funcionalidad es sólo para suscriptores

Suscribete