El impacto de la IA en los mercados de valores

Gary Gensler, el jefe en EE.UU. del equivalente a la CNMV en España, combina un profundo conocimiento de la tecnología y de los mercados con una gran capacidad de divulgación para transmitir en términos simples los cambios que se plantean

El valor de la función pública (03/04/2024)

El atajo mental del consenso (01/04/2024)

Esta funcionalidad es sólo para registrados

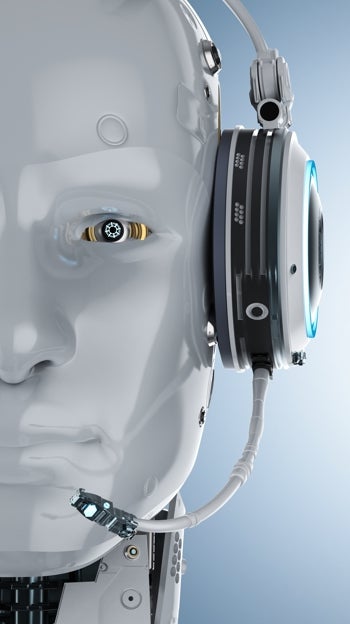

Iniciar sesiónGary Gensler, el presidente de la Comisión de Valores y Bolsa de Estados Unidos (conocida por sus siglas SEC), es un gran comunicador, pero también un profundo conocedor de la industria de la Inteligencia Artificial (IA). Gensler intuye por dónde pueden venir los problemas. ... Recientemente colgó un vídeo en X advirtiendo que los asesores de inversiones que mientan sobre el uso de la IA o las empresas que presuman de aplicarla para impulsar su cotización o atraer inversionistas pero no lo hagan en la realidad, serán sancionadas por el organismo que dirige. De hecho, ya se ha acuñado un concepto –'AI washing' en inglés– por imitación del 'greenwashing', el verdeo o ecoblanqueo de negocios que quieren hacerse pasar por respetuosos con el medio ambiente. Todos nos hemos dado cuenta de que, como sucedió con la burbuja de las puntocom, hoy hasta el negocio más pedestre está presumiendo de aplicar la IA en sus tareas, aunque el impacto sobre su actividad sea nimio.

No he visto una advertencia semejante en España, donde este fenómeno también se ha producido. Tampoco en las cuentas de la mayoría de los órganos reguladores en las redes sociales.

El tipo de liderazgo de Gensler combina hábilmente la 'potestas' (atribuciones legales de su cargo) y la 'auctoritas' (autoridad intangible fruto de su reputación). Él es capaz de reconocer que el algoritmo de su plataforma de vídeo lo tiene calado como un amante ñoño de las comedias románticas al tiempo que suelta un fino análisis sobre las consecuencias jurídicas y financieras de la llegada de la IA. Es lo que hizo, por ejemplo, el 13 de febrero pasado en la Facultad de Derecho de la Universidad de Yale (YLS, Yale Law School) que este año cumple 200 años de existencia. En él resumió los aspectos centrales de los desafíos para la estabilidad financiera que la IA pueda plantear en el futuro y que requerirán una nueva manera de concebir la regulación del sistema.

Gensler dijo que piensa que con la IA probablemente ocurra lo mismo que con la economía de las plataformas digitales, un proceso de fuerte concentración animado por la combinación del efecto red y las economías de escala: hay un buscador líder (Google), una plataforma minorista líder (Amazon) y tres proveedores de nube que mandan (Microsoft, Google y AWS). Cuando las aplicaciones de IA que la industria financiera está desarrollando se empiecen a popularizar, se promoverá un efecto rebaño mucho más poderoso que el que conocemos hoy en los mercados de valores y habrá un impacto fruto de la interconexión de redes. Ambos fenómenos conducen al riesgo sistémico.

Pero, ¿qué sucederá cuando a los efectos difíciles de discernir de la IA se una el fraude o la negligencia humana? Gensler reflexionó a partir de una tipología elaborada por una exalumna de Yale, Kara Stein, que trabajó en la SEC y que propuso hablar de «daños programables, predecibles e impredecibles». El daño programable es sencillo de caracterizar: si se utiliza un algoritmo para manipular o defraudar al público, eso es directamente un fraude. En cuanto al daño predecible, también resulta fácil verlo: ¿Ha ignorado imprudentemente o a sabiendas los riesgos previsibles de sus acciones, en este caso, implementar un modelo de IA en particular? ¿Actuó razonablemente para evitar los daños? En este caso, las precauciones, según Gensler, son sencillas de replicar en el mundo de la IA: «Según las leyes del mercado de valores, hay muchas cosas que no se pueden hacer. Esto incluye la inversión ventajista ('front-running'), lo que significa que si recibe una orden de un cliente, no debe negociar teniéndola en cuenta antes de haberla ejecutado. Se supone que no debes falsificar, es decir, enviar una orden falsa. Se supone que no debes mentirle al público. Se supone que los asesores de inversiones y los corredores de bolsa no deben anteponer sus intereses a los de sus clientes ni brindar consejos o recomendaciones de inversión inadecuados o contradictorios… Eso significa que debes asegurarte de que tu robot, me refiero al modelo de IA, no haga estas cosas».

Pero hay fenómenos muy intrigantes en la IA, como las 'hallucination' (alucinaciones), que es su tendencia a mentir e inventarse hechos. Esto puede producir auténticos desastres. Tampoco sabemos cómo va a resolver la IA los conflictos de intereses entre la plataforma y los clientes y si será capaz de actuar éticamente o no. ¿Qué pasa si la IA detecta una sesgo o una debilidad en el cliente y decide explotarla? Y, por último, la gran cuestión: qué sucederá si el algoritmo aprende y cambia por sí solo y se convierte en HAL 9000 o en Terminator. ¿Cómo se puede responsabilizar a las personas que están creando modelos de IA que puedan producir daños verdaderamente impredecibles?

Gensler se mostró convencido de que los más altos tribunales tendrán que pronunciarse en algún momento sobre el daño impredecible. (Mi opinión es que la responsabilidad de los creadores de IA sobre los efectos impredecibles equivale a la responsabilidad que los padres tienen sobre sus hijos en la historia). Sin embargo, el regulador norteamericano cree que en este momento las oportunidades de engaño o manipulación probablemente se encuentren en las categorías de daño programable y predecible en lugar de ser verdaderamente impredecibles.

Primer robot detenido en la historia

Gensler sugiere que a la IA se le debe aplicar la misma lógica que a los robots y cita el caso del primer robot que fue detenido en la historia: el DC-2 fabricado por la Android Amusement Corporation. La policía de Beverly Hills lo arrestó el 18 de agosto de 1982 por repartir tarjetas de visita en la calle y negarse a mostrar su identificación. Los policías se desesperaron buscando a la persona que lo controlaba a distancia (uno de los hijos del fundador de la empresa) y lo llevaron a comisaría.

Límite de sesiones alcanzadas

- El acceso al contenido Premium está abierto por cortesía del establecimiento donde te encuentras, pero ahora mismo hay demasiados usuarios conectados a la vez. Por favor, inténtalo pasados unos minutos.

Has superado el límite de sesiones

- Sólo puedes tener tres sesiones iniciadas a la vez. Hemos cerrado la sesión más antigua para que sigas navegando sin límites en el resto.

Esta funcionalidad es sólo para suscriptores

Suscribete

Esta funcionalidad es sólo para registrados

Iniciar sesiónEsta funcionalidad es sólo para suscriptores

Suscribete