Vídeo: Así funciona el decodificador que traduce impulsos neuronales

Una interfaz cerebro-ordenador traduce en palabras las señales neuronales que controlan los labios, la lengua y la mandíbula

ABC Multimedia

El genial físico británico Stephen Hawking dependía de un dispositivo para comunicarse a causa de la esclerosis lateral amiotrófica (ELA) que padecía. La traqueotomía a la que fue sometido lo dejó mudo, por lo que, con el cuerpo paralizado, utilizaba la mejilla para ... enviar comandos a un teclado virtual que luego eran transformados en sonido por un sintetizador de voz. Como el científico, muchas personas que han sufrido devastadores accidentes cerebrovasculares, trastornos neurológicos e incluso cáncer dependen de dispositivos semejantes para contactar con el mundo que los rodea. Estas tecnologías pueden resultar de gran ayuda, pero son mucho más lentas que la velocidad normal del habla humana: generalmente, permiten emitir ocho palabras por minuto, lo que está muy lejos de la comunicación fluida natural, con unas 150 palabras por minuto como promedio.

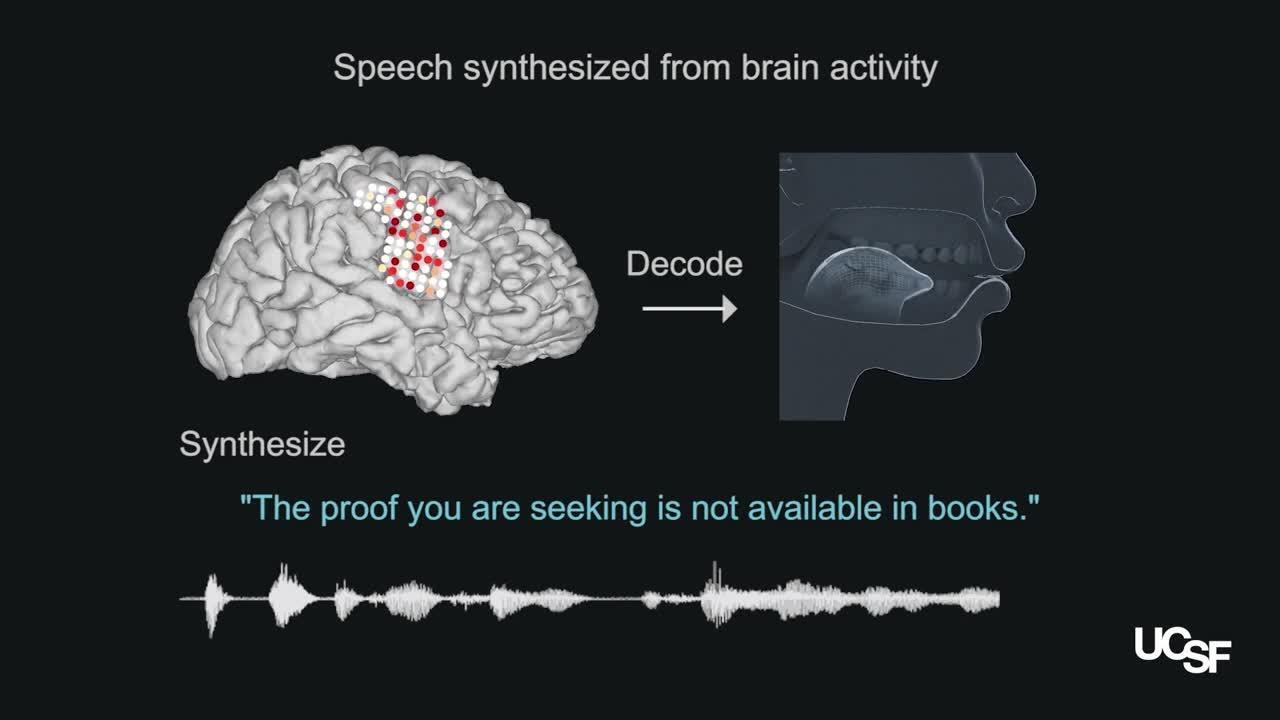

Pero quizás haya una forma de acelerar el proceso y devolver la voz a quienes la han perdido. Científicos estadounidenses de la Universidad de California en San Francisco y la de Emory en Atlanta han desarrollado una nueva interfaz cerebro-ordenador capaz de reproducir frases enteras directamente del pensamiento . Y lo han hecho gracias al «deep learning» (aprendizaje profundo), el sofisticado campo de inteligencia artificial que imita la manera en que aprende el cerebro humano. No es la primera vez que se da a conocer una máquina para «leer la mente» con una tecnología similar, pero en la mayoría de los casos solo han logrado captar palabras monosilábicas sueltas.

Siga leyendo esta noticia aquí.

Esta funcionalidad es sólo para suscriptores

Suscribete

Esta funcionalidad es sólo para registrados

Iniciar sesiónEsta funcionalidad es sólo para suscriptores

Suscribete